Итак, начнем. Здесь где-то должно быть красивое вступление, в стиле а вот знали ли вы о запланированном устаревании техники, о том, что многие производители специально не выпускают железо с таким расчетом, чтобы каждый год потребитель покупал новое. В конце концов, можно было бы даже рассказать о новой презентации Apple с их A17 и целой новой кнопкой…

…Но разговор пойдет о каких-то более приземленных вещах. В общем, написать статью меня натолкнул мой ноутбук. И это камень в огород AMD. Нет, нет — владельцы ультрабуков на Ryzen, и иже с ними могут успокоится, речь пойдет о «Доисторических временах».

И так, с третьей попытки — о чем статья?

О технологиях, которые забыты производителями, в виду чего владельцы техники получают вместо не самой плохой «железки» — тыкву! Рассмотрю:

-

Собственный прецедент (ставший поводом для статьи). (AMD Fusion)

-

Менее очевидные прецеденты. (Intel Kaby lake-G)

-

Вещи, о которых только слышал. (Itanium/Larrabee/Cannon Lake)

Прецедент — Драйвера APU + дискретная графика

Что это было: Технология гибридного использования дискретной и интегрированной графической карты.

Почему не взлетело: Производительность не оправдала ожиданий. Несмотря на то, что подобная технология полностью закрывала нижний ценовой сегмент, и позволяла очень бюджетным ноутбукам запускать современные игры.

Почему сейчас лучше такого не иметь, чем иметь: полное отсутствие поддержки на уровне драйверов. В лучшем случае из двух карт будет работать только дискретная. А в большинстве случаев, если карта не определит тип нагрузки, то будет пытаться запустить игры на интегрированной.

Итак, пациент: волшебный розовый ноутбук от HP, приобретенный в 2015-ом году, и служащий верой и правдой до сих пор (хотя уже и в состоянии умирающего лебедя). Ноутбук в нижнем ценовом сегменте (в свое время брался в районе 200 долларов). И обладающий для своей цены и лет, просто впечатляющими характеристиками.

-

4-х ядерный процессор от AMD.

НО! Без кеша первого и третьего уровня. Одно ядро – один поток.

-

12 гигабайт оперативной памяти (в стоке было 4, но это решилось).

НО! DDR3.

-

Прекрасный R8 365DX. Который представляет собой целых две видеокарты. R7 360 и R6 встроенный в процессор. С 2.5 гигабайтами памяти (естественно медленной DDR3, забираемой из общей котомки).

НО?

На момент Приобретения, это был самый мощный бюджетный ноутбук (ещё и розовый), который можно было добыть. Ключевое… Розовый бюджетный. А сама мощь достигалась за счет сдвоенной видеокарты, которая тащила все.

Шутка ли-нет, но в свое время, на этом ноутбуке, пускай и после определенного шаманства летал самый настоящий ведьмак-2.

Подвох был сразу, отсутствие кеша 1 и 3-го уровня. И винчестер на 5400 RPM, которые делали базовую работу с ноутбуком ещё хуже чем с его предшественником (Asus k53z 2010-го года). Но на деле, SSD решил проблему быстродействия в быту.

И вот, так являясь обладателем ноутбука за 200 долларов, который и для работы хорош (после установки SSD конечно), и выглядит хорошо, и даже на нем можно играть в какие-то игры. В один прекрасный день превратился в тыкву.

Произошло это году в 2018-ом…

Всего спустя 3 года, после выхода ноутбука, он перестал получать драйвера для графики. В то время, спасло две вещи.

-

Наличие более старых на харде.

-

Умение гуглить.

Собственно, на тех драйверах я и живу до сих пор. Но с каждым годом, с каждым обновлением Windows, они работают все хуже и хуже… Более того, современные игры уже не понимают AMD Fusion технологию, а значит в лучшем случае включается только R7 M360 (которая не так, чтобы сильно мощная видеокарта). А в худшем, игры запускаются и вовсе на R6, превращая геймплей в слайдшоу.

Конечно, можно сказать — обнови ноутбук, кто играет на бюджетных ноутбуках в игры сегодня? Но сам факт, что всего через 3 года, после выпуска ноутбука, производитель перестаёт выпускать драйвера, и самостоятельно превращает его в тыкву.

Сейчас, драйвера на этот HP найти очень сложно. Ни на сайте производителя ноутбуков. Ни на сайте AMD, нет этой графики.

А даже, если найти на AMD сайте, графику для APU для a10 8780, то она все равно полностью отключает встроенную графическую видеокарту, и подключает только R7. И да, можно было бы смириться с потерей части производительности, если бы не одно «но».

С современными драйверами, ноутбук регулярно падает в BSOD. Со старыми работает, как часы.

Почему кипишь?

И все-же, ну подумаешь, частный случай отказа AMD Fusion от конкретного процессора и видеокарты. Зачем подымать такой кипишь, что-то писать, что-то решать?

Ну во-первых, ноутбук до недавнего времени полностью устраивал своей производительностью (как рабочая машинка).

Во-вторых, любопытство, которое заставило подумать о том, что неужели это единственный случай когда производитель отказывается от своих же технологий, окирпичивая свои же девайсы.

Первым и самым очевидным вспомнилась техника Apple, которая с выходом каждой следующей модели, превращает предыдущие в «лагодром». Но это очевидно, это и все знают.

Но как поступают другие производители со своими неудачами, и какие из технологий не дошли до нашего времени? Как насчет:

-

Интеловского камня, со встроенной картой от AMD?

-

Первый 10 нанометровый процессор с ультранизким потреблением, который «не смог»

-

Xeon на стероидах, который мог-бы работать и в серверах, и в десктопах, но из-за своей сложности, так и остался локальным проектом, который производитель поддерживал постольку-поскольку были заключены какие-то контракты на поставку и обслуживание.

-

48 ядерная графика, прямиком из 2008-го?

И вероятно, это далеко не все, что есть за последние годы, но то, что бросилось в глаза.

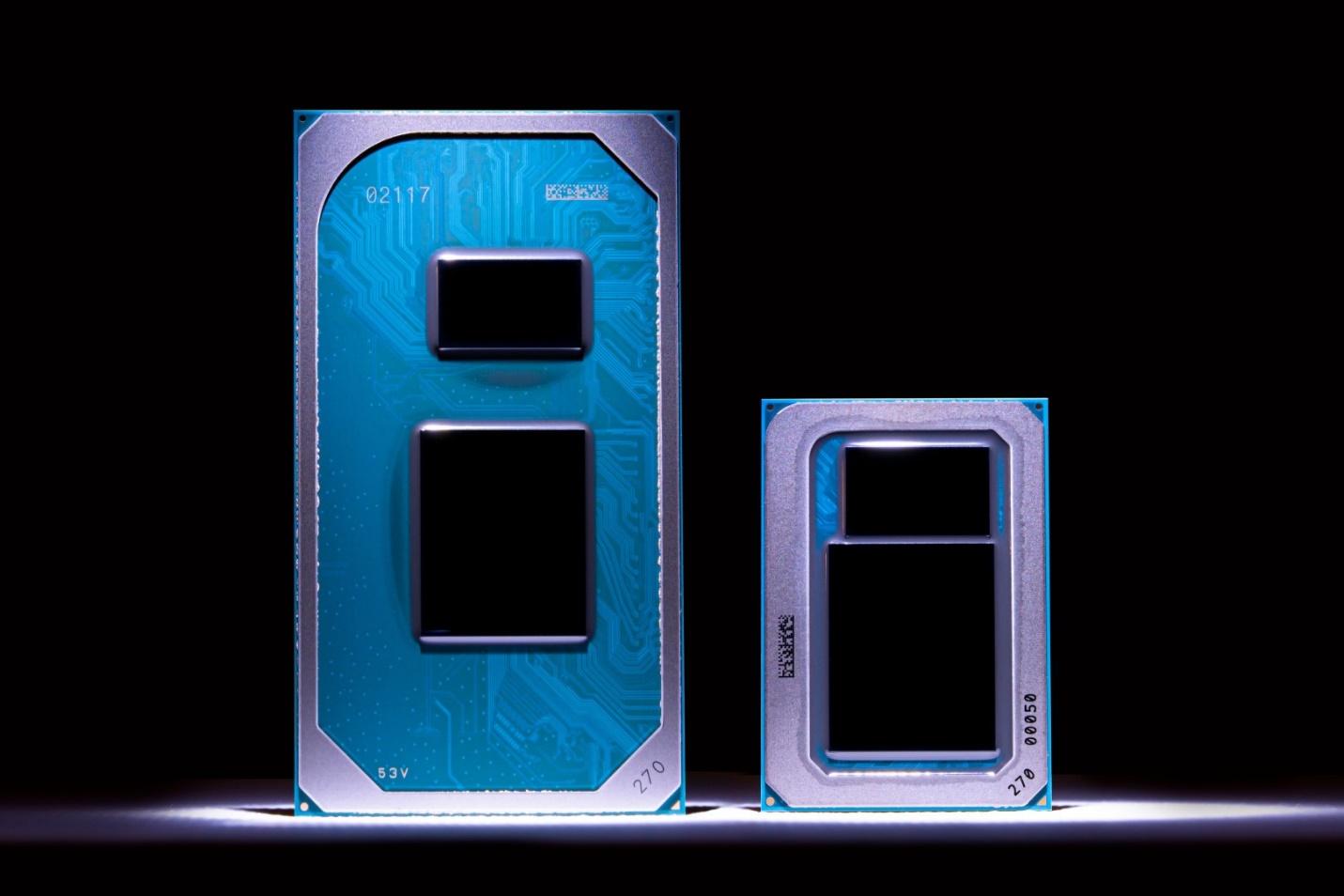

Intel Kaby Lake-G. Камень в огород синих? Красных?

Что это было? Процессор от Intel с встроенной «дискретной» графикой, и 4-мя гигабайтами распаянной графической памяти прямо на чипе процессора.

Почему не взлетело? Очень специфическое решение, не нашедшее своего потребителя. С одной стороны, полноценная Vega встроенная в процессор, это куда лучше чем UHD карты того времени. И тем не менее, она уступала любому Geforce или Radeon, по мощности. На выходе ни рыба, ни мясо. Слишком дорого для интегрированной видеокарты. Слишком слабо для дискретной. А затем подоспел и IRIS XE.

Почему сейчас лучше такого не иметь, чем иметь: По той же причине, по которой и предыдущий девайс. Хотя ситуация и не столь критичная. Kaby Lake G, не имеет свежих драйверов, что технически превращает его в полтыквы. С одной стороны, отдельные драйвера на Radeon Vega, который используется в рамках технологии все ещё выпускаются. С другой стороны, внутренняя синергия с процессором и внутренней памятью, распаянной прямо на чипе, утеряна.

Итак, начнем с очевидного. С полностью идентичной моей ситуации, но которая произошла с Intel и AMD буквально через полтора года после «окирпичивания» моего собственного девайса.

Это было очередное гениальное решение на стыке конкурентов. Полноценная VEGA в рамках 8-го поколения процессоров Intel. Тот случай, когда полноценная графика на чипе могла стать прекрасным решением для:

-

Ноутбуков.

-

OEM железок.

-

Бюджетных решений.

-

Мини-PC.

Но! Появление IRIS сломало все планы на компьютеры с хорошей (для своего времени) графикой по доступной цене. А даже если использовать процессоры этой серии вместе с дискретными графическими ускорителями, то распаянные 4 гигабайта памяти, можно было бы использовать для каких-то других целей.

Однако IRIS оказался дешевле, и всего через полтора года после выпуска Intel Kaby Lake G перестали получать обновления драйверов, что не позволяет использовать их в паре с современными ОС, или реализовывать потенциал Vega.

Cannon Lake Intel. I3 который не смог

Что это было? Попытка дать ответ ryzen в техпроцессе и энергопотреблении. Первый 10Нм процессор от Intel, появившийся ещё в 2018-ом году.

Почему не взлетело? Не смогли наладить серийное производство.

Почему сейчас лучше такого не иметь, чем иметь. Странная архитектура, большой процент брака, маломощные процессоры. В случае выхода из строя не подлежат гарантийному обмену.

Пострадали опять кто? Ноутбуки. А именно Lenovo a 330. Вообще на IXBT (не знаю можно ли класть ссылку на сторонние ресурсы) есть целая статья о других процессорах, в т.ч. 10 нм процессора с 16 потоками, родом из 2018-го года на 10 нанометрах.

Но до широкого потребителя дошел только i3 8121U.

Что о нем можно сказать? Да абсолютно ничего, кроме того, что Б/У ноутбуки с ним практически не дожили до наших дней, а те что есть, стоят подозрительно дешево (<$100). Возможно дело в высоком проценте брака, возможно ещё в чем.

Но, факт остаётся фактом. Великолепная технология. Шикарный техпроцесс, рывок, который совершили AMD со своим zen, мог принадлежать интелу.

Xeon на стероидах —Itanium

Что это было? Epic-процесор альтернатива находящемуся тогда в тупике x86-64

Почему не взлетело? Нацеливание исключительно на серверный рынок, и отстутсвие конкуренции в потребительском рынке замедлило инвестиции, и как следствие замедлило развитие архитектуры.

Почему сейчас лучше такого не иметь, чем иметь — здесь все неоднозначно. Неплохо иметь EPIC архитектурный сервер, если вы заморочены на безопасности. В виду его слабой распространенности, он защищен несколько лучше, и его уязвимости не известны широкому кругу лиц. С другой стороны, если вы ищете решение для массового использования, то дороговизна, и отсталость архитектуры сделают его худшим выбором.

Intel larrabee — вместо выводов

Что это было? 48 ядерный не то процессор, не то видеокарта RISC архитектуры.

Почему не взлетело? Сложность архитектуры, не позволяла адаптировать процесс написания ПО для неё.

Почему сейчас лучше такого не иметь, чем иметь. Технология не увидела свет.

Напоследок, захотелось рассказать об устройстве которое так и не вышло, и слава богу. А может и нет. Потому что тогда, эпоха видеокарт, которые могли бы тянуть ведьмака 3, могла начаться ещё до выхода ведьмака 3.

48 ядерная видеокарта. Звучит как рай для майнера, но — в отличие от предыдущих прецедентов, благо в этот раз устройство так и не вышло.

Intel Larrabee должен был составить конкуренцию AMD Fusion, когда та, должна была провести выпуск своих первых графических адаптеров, объединенных со всторенной графикой.

На момент анонса это должна была быть настоящая революция, готовая поспорить по мощности с Intel Geforce GTX 285.

Фактически, это был ответ «синих» тогдашней архитектуре Cell, которая при прочих равных имела солидный прирост производительности в отношении другого аппаратного обеспечения тех лет. Но сложность программирования под многоядерную RISC архитектуру с графическим чипом, решила все за Intel. И вместе с отказом от Cell архитектуры, Intel Отказался и от Larrabee.

А ведь просто представьте, какое могло нас ждать будущее, в котором 48 ядерные процессоры были бы в каждом доме? Шутка конечно. Технология показала свою несостоятельность ещё в те же годы. Но никто же не мешает по фантазировать?

А ведь ещё был и ARM для стационарных ПК. А ведь ещё были планшеты на x86. А ещё море того, о чем я со своим дилетантством даже не знаю!

П.С. Сейчас с таким же интересом наблюдаю за процессорами с E и P ядрами. Которые с одной стороны выглядят как следующий шаг в эволюции процессоров, а с другой стороны возникают опасения, не присоединяться ли они к орде забытых технологий, и не превратятся ли устройства на 12-ом и 13-ом поколении Intel в тыкву вот уже через 3-4 года?

_large.png)