Чтобы запечатлеть событие, достаточно воспользоваться соответствующим условиям съёмки инструментом. Последним может выступить как обычный смартфон или фотоаппарат, так и любой другой гаджет с интегрированным модулем камеры. Однако ввиду технических ограничений, а также ряда других причин не всегда удаётся снять происходящее действо от начала и до конца. Для случаев, когда за кадром остаются самые интересные моменты, на помощь готово прийти программное решение от учёных Массачусетского технологического института.

Усилиями специалистов лаборатории CSAIL был разработан самообучающийся алгоритм, способный не просто задействовать «компьютерное зрение» для идентификации объектов и окружающей их обстановки на представленном изображении, а сгенерировать на его основе короткий видеоряд. Проанализировав отдельные составляющие картинки и потенциальные варианты их взаимодействия, ПО предскажет, что могло бы произойти с предметами или людьми на следующем кадре.

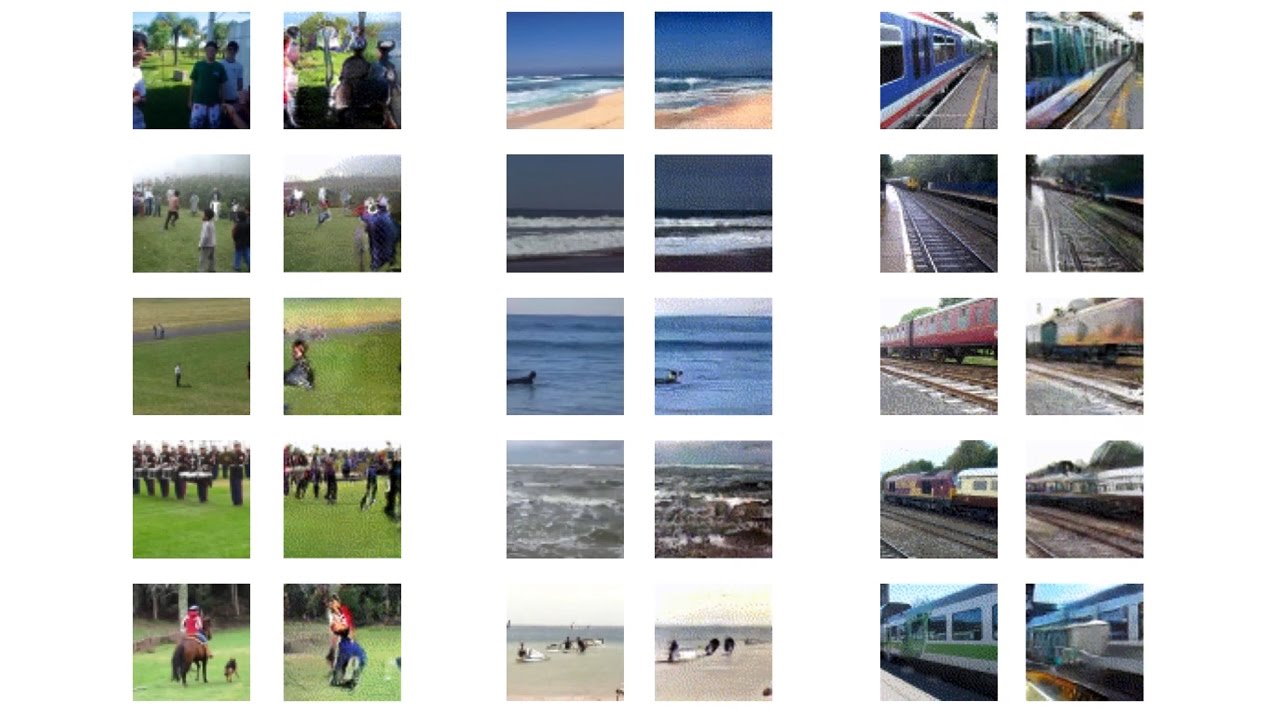

В основу «обучающего курса» системы, базирующейся на нейронных сетях и применяющей для вычислений «компьютерное зрение», легло детальное исследование 2 млн самых разнообразных видеофайлов. На данном этапе технология нуждается в глобальной доработке, так как процесс конвертации изображения в видео далёк от совершенства и лимитирован по ряду критериев. Длительность создаваемого программой ролика ограничена 1,5 с, а выглядит конечный результат пусть и имеющим право на жизнь, но не слишком реалистичным. К тому же нейросеть часто ошибается с масштабированием объектов. Тем не менее, рассматриваемая технология справилась с воссозданием таких сложных сцен, как омывающие побережье волны или марширующие по траве люди.

Источник: