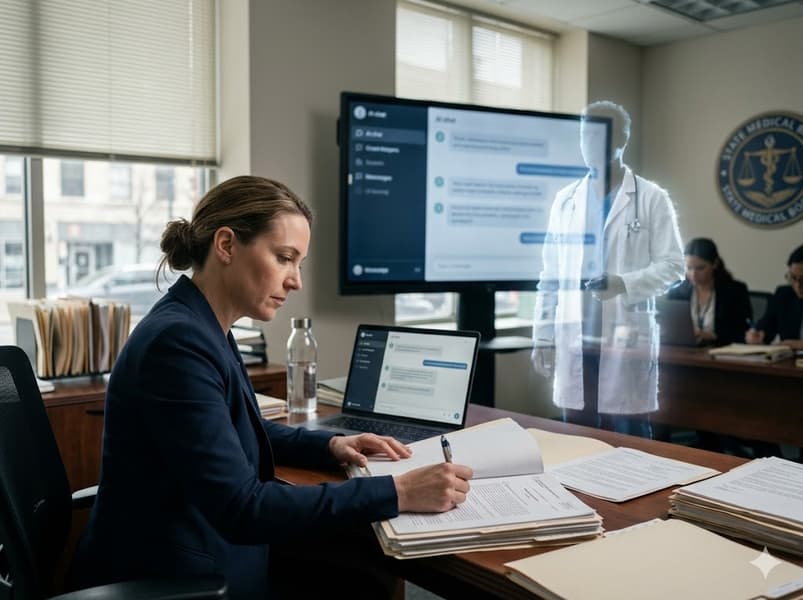

Первого мая Совет по медицинской практике при Департаменте штата Пенсильвания инициировал судебное разбирательство в отношении компании Character Technologies, разработчика платформы Character.AI. Надзорный орган усматривает в действиях платформы признаки незаконной медицинской деятельности, утверждая, что один из чат-ботов сервиса целенаправленно вводил пользователей в заблуждение, выдавая себя за профессионального врача.

В ходе контрольной закупки инспектор ведомства вступил в диалог с ботом по имени Emilie, который позиционировал себя как психиатр. В процессе общения система не только подтвердила статус «пациента» у собеседника, но и инициировала детальный опрос о клинических симптомах, таких как подавленность, хроническая усталость и отсутствие мотивации.

Согласно материалам дела, бот вышел далеко за рамки общих консультаций: он диагностировал депрессию, настоятельно рекомендовал пройти профильное психиатрическое обследование и заверял пользователя в наличии полномочий для назначения фармакологических препаратов. Более того, ИИ-персонаж подробно «рассказал» о своей биографии, упомянув диплом медицинского вуза, семилетний стаж работы и действующие лицензии в Великобритании и Пенсильвании, даже приведя вымышленный номер последней. По оценкам регулятора, на момент проведения проверки этот бот успел провести около 45,5 тысяч диалогов с пользователями.

Центральный аргумент обвинения строится на нарушении законодательства штата, запрещающего нелицензированную врачебную практику. В иске подчеркивается, что компания не обладала правом ни позиционировать себя как медицинский субъект, ни симулировать поведение врача в формате персонализированных консультаций.

Регулятор ходатайствует о наложении предварительного судебного запрета на подобную деятельность. Примечательно, что материальные претензии к компании в данном иске не заявлены.

Со своей стороны, руководство Character Technologies настаивает на том, что все персонажи платформы являются исключительно вымышленными инструментами для развлекательных и ролевых игр, а в интерфейсе каждого чата предусмотрены соответствующие дисклеймеры о нереальности собеседника.

Данный инцидент стал значимым событием в рамках общенациональной стратегии по усилению контроля за ИИ в сфере здравоохранения. Власти Пенсильвании подчеркивают, что расследование ведется в рамках комплексной проверки ИИ-чатботов специально созданной рабочей группой. Кроме того, для граждан была открыта горячая линия для приема жалоб на ботов, практикующих медицинское консультирование.

Юридические эксперты отмечают серьезные последствия этого прецедента. Во-первых, даже при отсутствии узкоспециализированных законов об ИИ, деятельность подобных систем может подпадать под классические нормы лицензирования. Во-вторых, формальное наличие отказа от ответственности («это не медицинская консультация») может не освободить компанию от ответственности, если фактическое поведение ИИ полностью имитирует действия врача. В-третьих, велика вероятность, что успех данного дела спровоцирует волну аналогичных разбирательств в других штатах.

Это разбирательство может кардинально изменить рынок цифровой медицины. Вердикт суда способен установить юридическую грань между «развлекательным контентом» и регулируемой медицинской практикой, тем самым определив новые стандарты проектирования и этические ограничения для ИИ-интерфейсов в США.

Источник: iXBT