По всей видимости, требования к объему памяти у специализированных ИИ-процессоров стремительно приближаются к показателям мощных графических ускорителей. Как сообщает издание Sedaily, разработчики чипов для искусственного интеллекта всерьез задумываются о значительном увеличении встроенной памяти в будущих поколениях своих решений.

Речь идет о показателях в 300–400 ГБ, что ставит их в один ряд с передовыми GPU-ускорителями. Для сравнения: современный Nvidia Vera Rubin располагает 288 ГБ, а готовящийся к выпуску AMD Instinct 400 предложит 432 ГБ. Важно подчеркнуть, что в данном контексте подразумевается именно HBM-память, при этом стоит учитывать, что тот же Vera Rubin дополнительно использует массив памяти SOCAMM2.

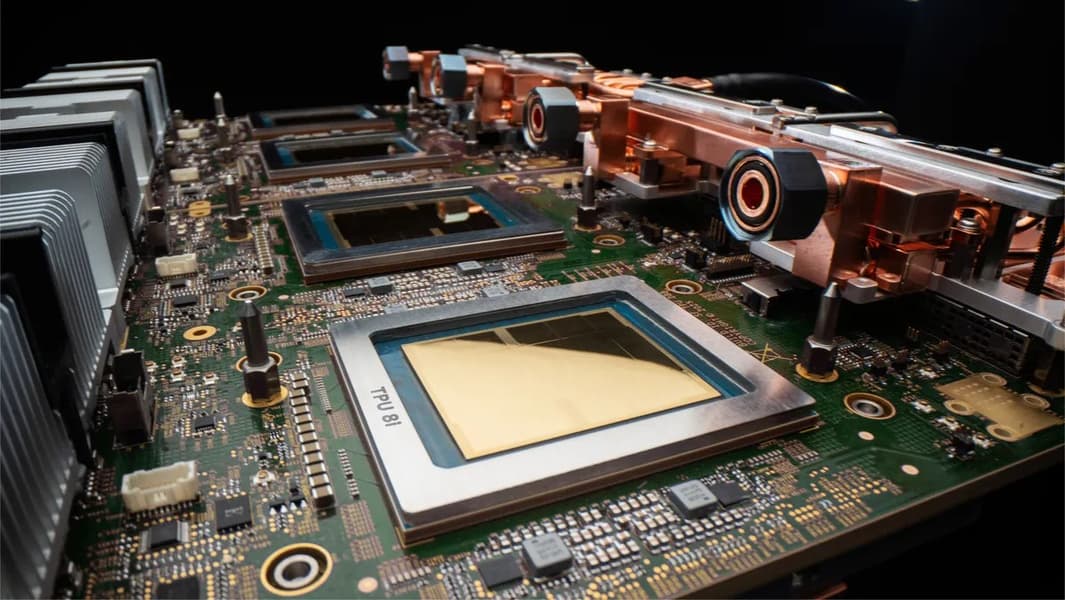

Если говорить о специализированных решениях, то, к примеру, актуальный TPU 8i от Google уже оснащен 288 ГБ памяти, в то время как еще недавно для большинства CPU нормой считались показатели в районе 100 ГБ.

Эта динамика крайне важна для индустрии: развитие агентных систем ИИ провоцирует резкий рост спроса на вычислительные мощности. Если раньше в дата-центрах на один CPU приходилось около восьми GPU, то сейчас это соотношение сократилось до 4:1. Прогнозы указывают на то, что в перспективе мы придем к пропорции 1:1. Разумеется, это произойдет не за счет сокращения количества GPU, а за счет радикального наращивания вычислительного парка центральных процессоров, что спровоцирует масштабную концентрацию памяти в инфраструктуре ИИ-ЦОД.

Источник: iXBT