Социальное взаимодействие между людьми является одним из основополагающих аспектов жизни. Родные, коллеги, друзья или совершенно незнакомые люди могут взаимодействовать с нами в самых разных сценариях. Одной из основных составляющих данного взаимодействия является мимика лица человека, способна без слов выразить эмоциональное состояние. Несмотря на культурные и этнические отличия разных народностей Земли, существует базовый набор выражений лица, который практически везде обладают одинаковым смыслом. К примеру, улыбка может зловещей, насмешливой, ироничной, притворной и т. д., но чаще всего она является признаком доброжелательности и миролюбивого настроения по отношению к собеседнику. Но что если собеседник робот? Ученые из Школы инженерии и прикладных наук Колумбийского университета (США) провели исследование, в котором попытались научить робота своевременной и уместной мимике в ответ на мимику собеседника-человека. Какой вид имел робот, чему удалось его научить, и как проходило его общение с людьми? Ответы на эти вопросы мы найдем в докладе ученых.

Основа исследования

Лицо человека оснащено множеством мышц, благодаря которым мы можем воспроизводить множество выражений, демонстрирующих наше психосоциальное состояние, т. е. эмоции. В ответ на определенные выражения лица человек может испытывать сочувствие, настороженность, дружественность, враждебность и т. д. Достаточно универсальным выражением лица, способствующим установлению дружелюбного взаимопонимания, является улыбка. Одновременная или почти одновременная улыбка двух собеседников ускоряет процесс их эмоционального сближения и укрепляет его.

Выражения лица широко изучаются в различных областях, таких как психология, нейробиология и робототехника. В случае некоторых мимических жестов наблюдение за движениями лица других людей может непреднамеренно вызвать спонтанные аналогичные движения лица. Например, атмосфера, создаваемая двумя одновременно улыбающимися людьми, часто может отражать взаимопонимание и искренность общения. Однако важно отметить, что это зеркалирование не является универсальным. В случаях социального несоответствия могут возникнуть противоположные реакции на лице, например, реакция страха или гнева. Незаметная, тонкая синхронизация некоторых выражений — это способность, которая может нести существенное эволюционное преимущество, поскольку способствует социальной сплоченности и взаимопониманию — и то, и другое имеет решающее значение для выживания группы. Если в повседневном общении человек демонстрирует запоздалую улыбку, в то время как другие улыбаются в унисон, это может быть воспринято как неискреннее поведение.

Нельзя считать мимику лица универсальным языком выражения и интерпретации эмоций, ведь восприятие может отличаться в рамках определенных возрастных, этнических или культурных групп.

Авторы исследования считают, что в области взаимодействия человека и робота важность упреждающего выражения лица имеет первостепенное значение. Как было сказано выше, во время взаимодействия люди склонны к одновременной мимической реакции (например, одновременная улыбка). В настоящее время большинство роботов могут воспринимать человеческие эмоции, но реакция на них следует постфактум. Таким реактивным выражениям не хватает аутентичности и непосредственности, которые свойственны общению между людьми. Другими словами, к роботам, которые могут выражать эмоции лишь в ответ на человеческие выражения лица, доверие со стороны людей будет значительно ниже.

Люди могут генерировать тысячи различных выражений лица, чтобы передавать бесчисленные нюансы эмоциональных состояний, и эта способность является одним из наиболее мощных и эффективных интерфейсов социального взаимодействия человека. За последние несколько лет роботы стали значительно продвинутее благодаря разработкам в области искусственного интеллекта, но в области лицевых «мышц» робота прогресс был относительно небольшим. Лицевая аниматроника требует сложного аппаратного и программного обеспечения. Хотя прошлые работы привели к созданию впечатляющих человекоподобных роботов с более реалистичными лицами, они в основном полагаются на заранее запрограммированную лицевую анимацию, а не на спонтанность. Недавние разработки в области лицевой робототехники были направлены на диверсификацию и улучшение динамических мимических выражений эмоций, что является шагом к созданию более натуральных взаимодействий между человеком и машиной.

Изображение №1

Созданная авторами исследования роботизированная платформа Ева (Eva) была ранним примером робота, способного самостоятельно моделировать выражения лица. Однако для достижения более убедительного социального взаимодействия робот должен научиться предсказывать не только выражение своего лица, но и выражение лица собеседника, с которым он общается.

Видео №1

В рассматриваемом нами сегодня исследовании ученые описывают антропоморфного робота под названием Эмо, который имеет значительные аппаратные улучшения по сравнению с Евой. Эмо оснащен 26 приводами (23 — для выражения лица, 3 — для движения шеи), которые позволяют выражать больший диапазон эмоций, в отличие от Евы, у которой было всего 10 приводов. Эмо также оснащен камерами (в глазах), позволяющими в реальном времени воспринимать эмоции людей-собеседников и реагировать на них. Лицо робота покрыто искусственной кожей. Самой же важной составляющей Эмо является модернизированная инверсная модель, которая позволяет роботу генерировать двигательные команды в 5 раз быстрее, чем предыдущее поколение. Также использовалась прогностическая модель, позволяющая роботу предугадывать выражение лица собеседника в режиме реального времени.

Результаты исследования

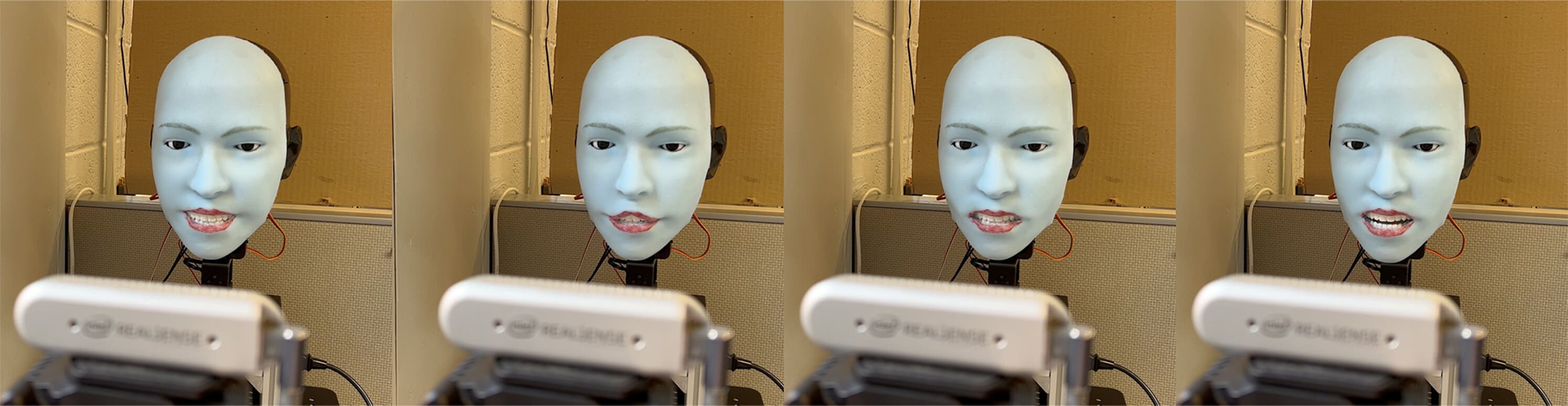

Изображение №2

Исследование проводилось с использованием роботизированной головы с 26 приводами и сменной искусственной кожей, изготовленной из силикона и прикрепленной к роботизированному оборудованию с помощью 30 магнитов (2A). Роботизированную кожу лица можно заменить альтернативными конструкциями для достижения другого внешнего вида робота (2B). Робот состоит из трех модулей: двух глазных модулей, ротового модуля и шейного модуля.

Глазной модуль управляет движениями глазных яблок, бровей и век (2C). Каждый глаз оснащен RGB-камерой высокого разрешения. Глазной модуль приводится в движение отдельно двумя моторами через параллелограммный механизм по двум осям тангажа (вверх/вниз относительно горизонтальной оси) и рыскания (влево/вправо относительно вертикальной оси). Данная конструкция позволяет установить камеру на месте, где у людей располагается зрачок, тем самым делая лицо робота более антропоморфным.

Видео №2

Движение рта было сложнее. В то время как лица большинства аниматронных роботов обычно демонстрируют только простые движения челюсти, ученые стремились воспроизвести сложное движение человеческих губ с помощью механической конструкции. Чтобы решить эту задачу, ученые спроектировали несколько пассивных соединений и связей, чтобы при движении рта робота мягкая кожа могла сгибаться за счет пассивных степеней свободы механической конструкции, образуя сложные, но естественно выглядящие деформации. Модуль рта содержит 9 кинематических цепей (2D). Шесть из них с пассивными суставами управляют верхней и нижней губой, два управляют движениями угла рта, а последний механизм управляет движением челюсти.

Видео №3

Ученые использовали машинное обучение с самоконтролем, позволяющее научить робота генерировать человеческие выражения лица без явной хореографии движений. Традиционный метод управления роботами опирается на кинематические уравнения и моделирование, но это применимо только к роботам с твердым телом и известной кинематикой. Исследуемый робот имеет мягкую деформируемую кожу и несколько пассивных механизмов с четырьмя гнездовыми шарнирами, поэтому получить кинематическое уравнение кинематики робота затруднительно. Решением этой проблемы стал визуальный метод обучения с самоконтролем, при котором робот может изучить взаимосвязь между двигательными командами и результирующим выражением лица, наблюдая за собой в зеркале.

Выражением лица робота управляют 19 моторов, из которых 18 расположены симметрично, а один мотор управляет движением челюсти. Все выражения в наборе лицевых данных симметричны. Это означает, что симметрично распределенные двигатели могут использовать одни и те же команды. Следовательно, фактическим командам управления требуется только 11 параметров, нормализованных к диапазону [0, 1].

Изображение №3

Инвертированная модель выражений лица обучалась с использованием набора данных, сгенерированного самим роботом (фото выше), который состоял из двигательных команд и результирующих лицевых ориентиров.

Учитывая наличие набора данных двигательных команд и лицевых ориентиров, ученые стремились обучить инвертированную модель, которая, учитывая лицевые ориентиры, могла бы генерировать соответствующие двигательные команды. Данная модель состоит из нескольких слоев многослойных перцептронов, которые неявно фиксируют морфологию, эластичность и кинематику лица робота. Каждый базовый кортеж* состоит из целого набора лицевых ориентиров, представленного вектором размером 113 × 2 и соответствующими 11 значениями моторики.

Кортеж* — это основной строительный блок реляционных баз данных, представляющий упорядоченные элементы данных или записи в таблице. Кортежи обеспечивают эффективную организацию, хранение и поиск многомерных данных.

Было собрано 1000 точек данных, из которых 200 использовались для проверки (валидации), а остальные 800 — для обучения. Поскольку движение модуля глаз в верхней половине лица робота относительно независимо от движения модуля рта в нижней половине, общий набор обучающих данных можно разделить на две части. Данные обучения могут быть дополнены путем извлечения ориентиров верхней половины лица (52 х 2) и ориентиров нижней половины лица (61 х 2) соответственно из двух отдельных поднаборов данных и объединения их вместе для формирования расширенных данных.

Изображение №4

Оценка эффективности инвертированной модели проводилась методом сравнения используемого метода с тремя базовыми показателями. Первый базовый показатель — случайная генерация двигательных команд, а второй — случайная выборка и сравнение команд из набора обучающих данных. В обоих случаях используется случайный выбор, но в разных распределениях, поскольку команды, которые использовались для создания набора данных инвертированной модели, изменяются с помощью функций ограничений. Третий показатель — ближайший сосед. Он сравнивает ориентиры с набором обучающих данных и напрямую использует команду ближайшего ориентира в качестве выходных данных. На диаграмме 4A показан результат оценки инвертированной модели, которая генерирует двигательные команды, в результате чего выражения лица становятся более точными.

Чтобы робот мог достичь аутентичного и своевременного выражения лица, он должен заранее предвидеть его, давая своему механическому аппарату достаточно времени для срабатывания. Для этого ученые разработали прогностическую модель выражения лица и обучили ее с помощью набора видеоданных о людях, демонстрирующих различные выражения лица. Модель способна предсказать выражение лица человека на основе лишь первоначальных и незначительных изменений на лице.

Сначала ученые количественно оценили динамику выражения лица, используя евклидово расстояние между каждым набором ориентиров лица и ориентирами начального («спокойного») выражения лица в каждом видео. Ориентиры лица в состоянии покоя были определены как средние ориентиры первых пяти кадров, а целевые ориентиры лица — как те, которые максимально отличаются от ориентиров лица в состоянии покоя. Евклидово расстояние между ориентирами в состоянии покоя и ориентирами на других кадрах постоянно меняется и может быть дифференцировано. Следовательно, можно рассчитать тенденцию изменения выражения через вторую производную расстояния до ориентира по времени.

Набор данных содержал в общей сложности 45 участников и 970 видео. Восемьдесят процентов данных использовались для обучения модели, а остальные — для проверки. Анализ всего набора данных позволил вычислить среднее время, которое люди обычно тратят на выражение лица, как 0.841 ± 0.713 секунды. Модель прогнозирования и инвертированная модель могут работать со скоростью около 650 кадров в секунду и 8000 кадров в секунду соответственно на MacBook Pro 2019 без GPU. Эта частота кадров не включает время захвата данных или выделения ориентиров. Испытуемый робот может успешно предсказывать целевые выражения лица человека и генерировать соответствующие двигательные команды в течение 0.002 секунды.

Оценка точности прогностической модели (4B) показала, что данная модель намного более эффективная по сравнению с другими, демонстрируя меньшую среднюю ошибку прогнозирования.

Финальным этапом является одновременная работа инвертированной и прогностической моделей, нацеленного на демонстрацию выражения лица робота в соответствии с выражением лица человека. Другими словами, робот должен быстро и точно предугадать выражение лица человека и сгенерировать его же.

Ученые провели эксперимент, запустив свою модель и базовую модель мимикрии на роботе. Сравнение обоих методов показано на 1C. В этой экспериментальной установке временная шкала начинается в момент t = 0, который отмечает отправную точку, когда и робот, и человеческое лицо начинают процесс выражения. Когда t = n, это представляет собой момент, когда робот обнаруживает пиковую активацию и начинает предсказывать выражения лица человека. Цель состоит в том, чтобы добиться одновременного выражения лица человека и робота, когда t = m, где m обозначает целевое время, к которому робот стремится выразить выражению лица, как у человека.

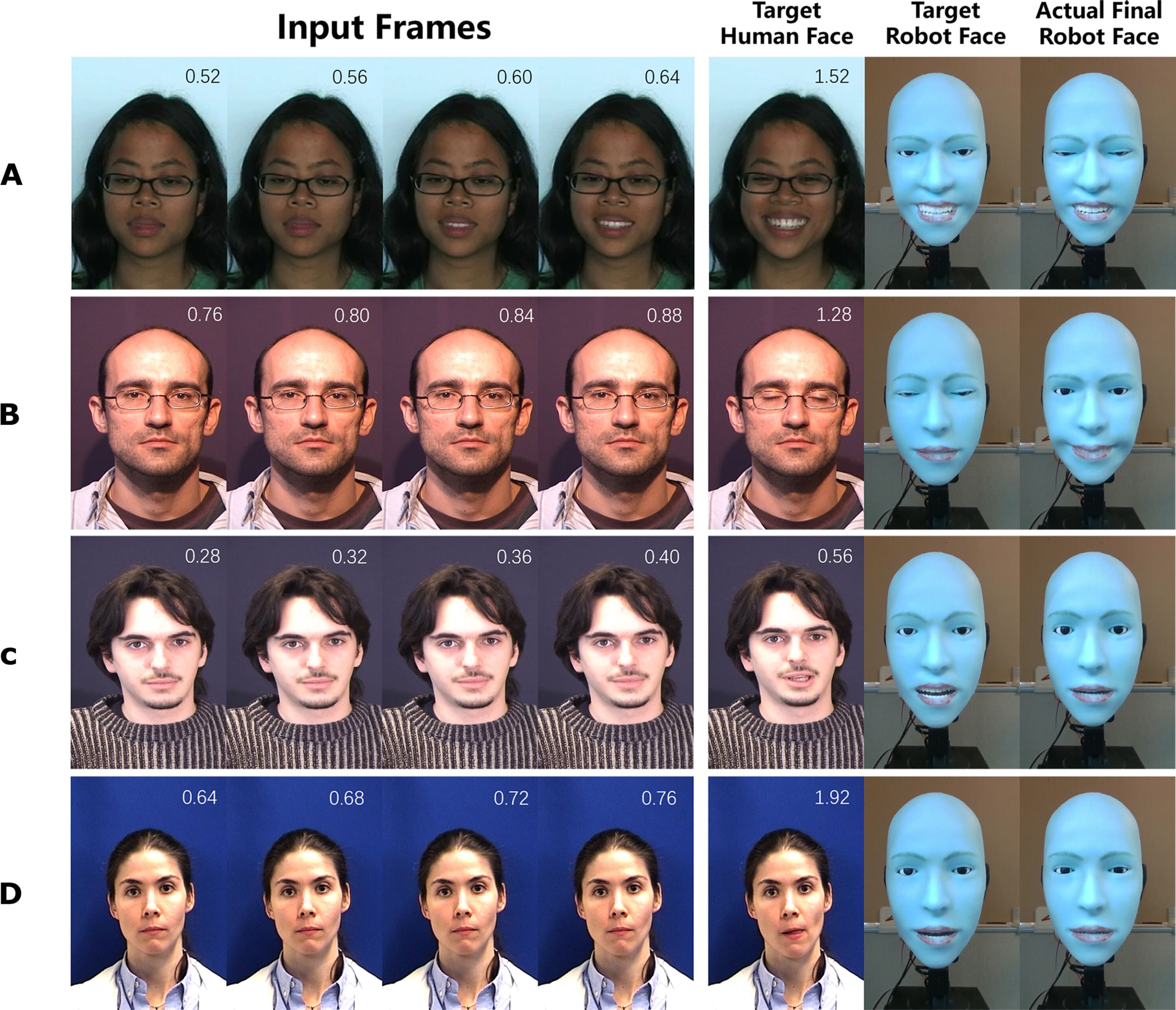

Изображение №5

Ученые провели эксперименты с использованием видео различных людей с разными выражениями лица. Производительность была рассчитана на основе набора тестовых данных, использованного для обучения прогностической модели. Столбцы с четырьмя последовательными кадрами — это входные данные, наблюдаемые прогностической моделью. Столбец целевого лица — это целевое выражение лица, которое не демонстрируется роботу. Истинные изображения — это нормализованные целевые ориентиры лица, которые непосредственно помещаются в инвертированную модель для создания целевого выражения лица робота.

Снимки лица робота (крайняя правая колонка) отчетливо демонстрируют, что робот успешно предсказывал выражение лица человека и выражал его сам.

Чтобы дополнительно оценить эффективность робота в прогнозировании выражений лица, ученые построили матрицу несоответствия на основе команд прогнозирования выражений лица. Основная задача заключалась в том, чтобы предсказать команды, которые будут генерировать целевые выражения лица. Учитывая, что команды нормированы между 0 и 1, что соответствует активации мышц на лице робота, каждую команду можно классифицировать как активированную или нет. Каждое выражение лица генерируется набором из 11 двигательных команд, каждая из которых представляет собой приведение в действие мышц на лице робота. Набор данных включал 214 тестовых выборок, в результате чего общая популяция составила 2354 команды.

Видео №4

Мышцы лица робота в состоянии покоя использовались в качестве контрольной точки и определили положительные образцы как те, в которых расстояние L1 между целевыми командами лица и командами спокойного лица превышает 0.25. Выбор расстояния L1 и порога 0.25 определяется нормализацией команд в диапазоне от 0 до 1. Таким образом, спокойное лицо с диапазоном ±0.25 охватывает половину области, что составляет 0.5. И наоборот, отрицательные образцы определяются как образцы, в которых это расстояние находится в пределах 0.25. Если прогнозируемые команды попадают в тот же регион, что и целевые команды, то они считаются истинными, в противном случае они классифицируются как ложные.

Изображение №6

Выше показан процесс прогнозирования и сравнение с реальными данными в четырех репрезентативных случаях. На 6A показан истинно положительный случай, когда робот правильно предсказал широкую улыбку по спокойному лицу человека. На 6B показан ложноположительный случай, когда робот неточно предсказал улыбку, хотя на самом деле мышцы лица были более спокойными. На 6C представлен ложноотрицательный случай, когда роботу не удалось предсказать выражение лица. Наконец, на 6D показан истинно отрицательный случай, когда робот точно предсказал, что не было никаких существенных отличий целевого выражения лица от первоначального спокойного лица. Анализ работы прогностической модели показал, что точность прогноза составляет 80.5 %.

Для более детального ознакомления с нюансами исследования рекомендую заглянуть в доклад ученых и дополнительные материалы к нему.

Эпилог

В рассмотренном нами сегодня труде ученые уделили внимание мимики роботов и людей. Выражение лица является не только хорошим показателем эмоционального или физиологического состояния человека, но и инструментом для налаживания коммуникаций между людьми. Несмотря на возрастные, культурные или этнические отличия между людьми, существует некий базовый набор выражений лица, которые служат универсальным языком. Одним из таких выражений является улыбка, которая практически всегда обозначает доброжелательное отношение к собеседнику (конечно, есть множество исключений: разная интерпретация улыбки из-за культурно-этнических особенностей, фальшивая улыбка и т. д.).

Искусственный интеллект и робототехника современности обладают отличными показателями, когда речь идет о вербальном (или письменном) общении. А вот с эмоциональным аспектом общения дела обстоят не так радужно. Обучить робота красиво говорить оказалось проще, чем научить его понимать эмоции человека и выражать свои.

Авторы рассмотренного нами сегодня труда справились с этой задачей. Объединив инвертированную и прогностическую модели, они создали робота (роботизированное лицо) по имени Эмо, способного предугадывать выражение лица человека еще до того, как он его выразит. Робот может предсказывать предстоящую улыбку примерно за 840 миллисекунд до того, как человек улыбнется, и выражать улыбку одновременно с человеком. Под маской из силикона спрятано 26 актуаторов, которые обеспечивают подвижность разных участков лица робота.

Авторы разработки планируют интегрировать в робота Эмо вербальное общение посредством больших языковых моделей (например, ChatGPT). Ученые уверены, что создание роботов, которые могут точно интерпретировать и имитировать человеческие выражения лица и эмоции, приближает нас к будущему, в котором роботы смогут легко интегрироваться в нашу повседневную жизнь, предлагая общение, помощь и даже сочувствие.

Немного рекламы

Спасибо, что остаётесь с нами. Вам нравятся наши статьи? Хотите видеть больше интересных материалов? Поддержите нас, оформив заказ или порекомендовав знакомым, облачные VPS для разработчиков от $4.99, уникальный аналог entry-level серверов, который был придуман нами для Вас: Вся правда о VPS (KVM) E5-2697 v3 (6 Cores) 10GB DDR4 480GB SSD 1Gbps от $19 или как правильно делить сервер? (доступны варианты с RAID1 и RAID10, до 24 ядер и до 40GB DDR4).

Dell R730xd в 2 раза дешевле в дата-центре Maincubes Tier IV в Амстердаме? Только у нас 2 х Intel TetraDeca-Core Xeon 2x E5-2697v3 2.6GHz 14C 64GB DDR4 4x960GB SSD 1Gbps 100 ТВ от $199 в Нидерландах! Dell R420 — 2x E5-2430 2.2Ghz 6C 128GB DDR3 2x960GB SSD 1Gbps 100TB — от $99! Читайте о том Как построить инфраструктуру корп. класса c применением серверов Dell R730xd Е5-2650 v4 стоимостью 9000 евро за копейки?