Системы искусственного интеллекта (ИИ) получают всё большее распространение. В связи с этим юристы и законодатели обсуждают проблему, каким образом должны регулироваться такие системы, кто будет нести ответственность за их действия. Этот вопрос требует внимательного изучения и взвешенного подхода, потому что системы ИИ способны генерировать огромные массивы данных и применяться в приложениях разной функциональности — от медицинских систем и автопилотов в автомобилях до предсказания преступлений и вычисления потенциальных преступников. При этом учёные стремятся к созданию «сильного ИИ», способного к рассуждениям, и здесь возникает вопрос, как определить наличие умысла в его действиях — или признать действия неумышленными.

Системы искусственного интеллекта (ИИ) получают всё большее распространение. В связи с этим юристы и законодатели обсуждают проблему, каким образом должны регулироваться такие системы, кто будет нести ответственность за их действия. Этот вопрос требует внимательного изучения и взвешенного подхода, потому что системы ИИ способны генерировать огромные массивы данных и применяться в приложениях разной функциональности — от медицинских систем и автопилотов в автомобилях до предсказания преступлений и вычисления потенциальных преступников. При этом учёные стремятся к созданию «сильного ИИ», способного к рассуждениям, и здесь возникает вопрос, как определить наличие умысла в его действиях — или признать действия неумышленными.

Есть много способов привлечь к отчётности и ответственности систему ИИ, на эту тему опубликовано несколько исследований. В новой научной работе специалисты по компьютерным наукам, когнитивным наукам и юристов из Гарвардского и Кембриджского университетов (США) обсуждают одну составляющую будущей системы подотчётности ИИ, а именно — роль объяснительной записки от ИИ, то есть оценку того, как система искусственного интеллекта объясняет свои действия. Учёные пришли к выводу, что модуль объяснения действий должен быть отделён от общей системы ИИ.

Авторы научной работы описывают все проблемы, которые возникают при попытке запросить у системы ИИ объяснение её действий.

Во-первых, такая возможность должна быть предусмотрена на этапе разработки системы, иначе ИИ может отказаться или будет не способен объяснить свои действия.

Во-вторых, система ИИ обрабатывает большой массив данных с помощью сложных проприетарных алгоритмов или методами, которые она сама выработала в процессе обучения. Таким образом, при попытке объяснить свои действия наиболее полным образом она может сгенерировать слишком много данных, непонятных человеку. Или — как другая крайность — предоставит слишком упрощённую модель, которая не будет отражать реальные намерения ИИ и мотивы поступков. Кроме того, алгоритмы работы системы ИИ могут быть интеллектуальной собственностью компании-разработчика, так что следует предусмотреть такой способ составления объяснительной записки, чтобы установить причины действий системы, но не выдать лежащие в основе алгоритмы.

Исследователи считают, что объяснение возможно без раскрытия алгоритмов и правил, лежащих в основе функционирования системы ИИ. В случае инцидента система должна предоставить ответы на следующие вопросы:

- Какие основные факторы повлияли на решение?

- Привело бы изменение определённого фактора к изменению решения?

- Почему два похожих случая привели к разным решениям?

Ответы на такие вопросы не обязательно требуют раскрытия проприетарных секретов и внутренних алгоритмов системы, но в то же время дадут чёткое понимание её мотивов.

Учёные рассуждают, в каких случаях уместно требовать от ИИ объяснения его действий. По сути, это требуется в тех случаях, когда выгода от объяснения перевешивает цену его получения: «Мы считаем, что есть три условия для ситуаций, когда общество считает необходимым получить объяснение у лица, принимающего решение. Это моральные, социальные или юридические причины», — объясняет Финале Доши-Велез (Finale Doshi-Velez), ведущий автор научной работы.

При этом не следует требовать объяснений от ИИ буквально в каждой ситуации. Как уже говорилось выше, это повышает риски выдачи торговых секретов и возлагает дополнительную нагрузку на разработчиков систем ИИ. Другими словами, постоянная подотчётность ИИ человеку затормозит развитие этих систем, в том числе в важных для человека областях.

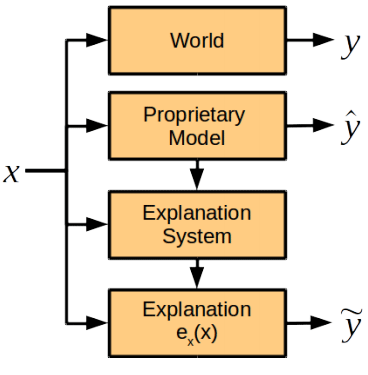

В отличие от распространённого мнения, что система ИИ — это чёрный ящик, причины поступков которого непостижимы для человека, авторы научной работы уверены, что можно разработать нормально функционирующий модуль объяснения действий ИИ. Этот модуль будет интегрирован в систему, но работать независимо от алгоритмов принятия решений и не подчиняться им.

Учёные считают, что существуют некоторые моменты объяснения поступков, которые людям легко изложить, а машинам — тяжело, и наоборот.

Сравнение способностей человека и ИИ к объяснению

| Человек | ИИ | |

|---|---|---|

| Преимущества | Может объяснить поступок апостериори | Воспроизводимость ситуации, отсутствие социального давления |

| Недостатки | Может быть неточным и ненадёжным, чувствует социальное давление | Требует предварительного программирования модуля объяснения, дополнительных таксономий и расширения системы хранения данных |

Тем не менее, группа экспертов рекомендует в первое время установить для систем ИИ тот же стандарт для объяснения своих действий, который сегодня установлен для людей (этот стандарт прописан в законодательстве США: в частности, объяснение требуется в случаях несения строгой ответственности, развода и дискриминации, для принятия административных решений и от судей и присяжных для объяснения своих решений — хотя уровень детализации объяснительной записки сильно отличается в каждом случае).

Но если причины действий ИИ выйдут за пределы понимания человека, то с целью подотчётности ИИ в будущем можно разработать другой стандарт для их объяснительных записок, считают учёные.

Научная статья опубликована 3 ноября 2017 года на сайте препринтов arXiv.org (arXiv:1711.01134v1).

Источник