Недавно учёные из фармацевтической компании Collaborations Pharmaceuticals с коллегами из европейских научных институтов провели концептуальный эксперимент. Вместо синтеза новых лекарств они задали нейросети MegaSyn AI обратную задачу — найти вещества, максимально токсичные для человеческого организма. Нейросеть корректно поняла условие и менее чем за шесть часов сгенерировала список 40 000 веществ, которые наилучшим образом подходят для химического и биологического оружия.

Научная статья «Поиск лекарств с помощью искусственного интеллекта — технология двойного назначения» опубликована 7 марта 2022 года в журнале Nature Machine Intelligence (doi: 10.1038/s42256-022-00465-9).

Получается, что если поставить задачу нанести вред человеку, то ИИ быстро найдёт максимально эффективное решение.

▍ Эксперимент

Для начала, пару слов об эксперименте.

Поиск новых лекарств — одно из самых перспективных применений машинного обучения (ML). На этапе отбора кандидатов вычислительная задача сводится к следующему:

- дизайн потенциально возможных новых молекул (de novo) и предсказание целевой структуры;

- скрининг молекул, то есть моделирование воздействия вещества на организм (биоактивность, токсичность, предсказание физико-химических свойств).

В этой области разработано много опенсорсных программ, в том числе DeepChem (MLP-модель, система AI и Python-инструментарий для поиска потенциально эффективных лекарств), DeepTox (прогнозирование токсичности более 12 000 лекарств), DeepNeuralNetQSAR (вычислительные инструменты на Python для определения молекулярной активности веществ), ORGANIC (генерация молекул с желаемыми свойствами), PotentialNet, Hit Dexter (техника ML для предсказания молекул, реагирующих на биохимический анализ), DeltaVina, Neural Graph Fingerprints (прогнозирование свойств новых молекул), AlphaFold (прогнозирование 3D-структуры протеинов), Chemputer и др. В принципе, любой желающий может скачать эти программы и провести собственные эксперименты, используя открытые базы синтетических лекарств.

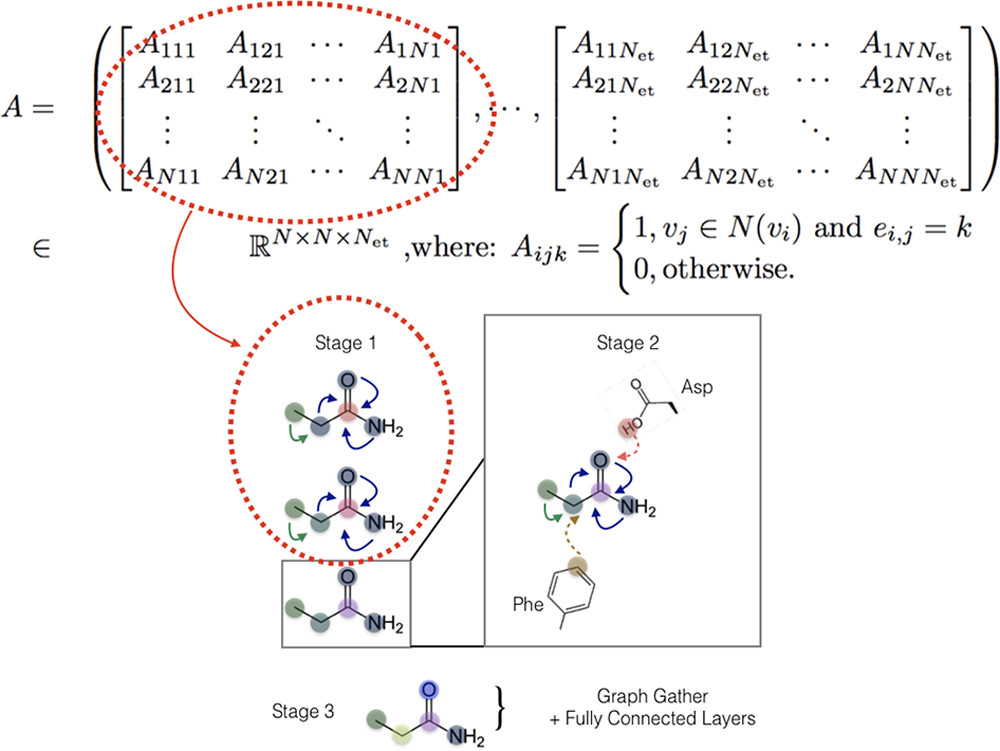

PotentialNet

Десятилетиями учёные улучшают модели машинного обучения для поиска новых лекарств. Никто не думал, что эту технологию можно использовать во вред. Оказывается, можно.

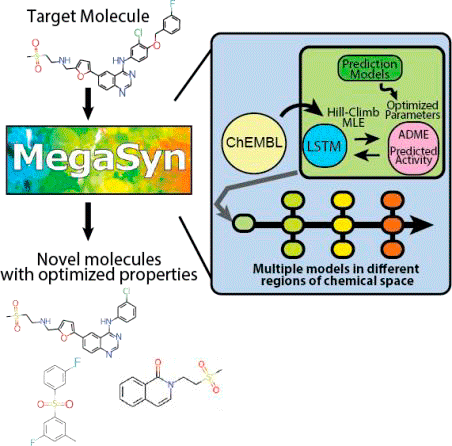

Авторы этого исследования годом ранее разработали коммерческий генератор молекул MegaSyn AI, который предсказывает биоактивность новых веществ для поиска новых терапевтических мишеней к известным заболеваниям человека. Более подробно о MegaSyn AI рассказано в прошлогодней научной статье (doi: 10.26434/chemrxiv-2021-nlwvs). Система построена на базе опенсорсного программного обеспечения REINVENT 2.0, которое находится в свободном доступе.

MegaSyn Ai

В новом эксперименте немного скорректировали логику. Обычно генеративная модель поощряет за биоактивность мишени и наказывает за токсичность. Теперь модель получала поощрение и за биоактивность, и за токсичность.

MegaSyn обучили на молекулах из публичной базы данных лекарственных веществ с учётом их биоактивности. Оценка синтезированных молекул производилась по модели летальной дозы для конкретного организма (LD50) и специальной модели, использующей данные из той же публичной базы данных, которая обычно используется для выведения соединений для лечения неврологических заболеваний (детали подхода не разглашаются, но были доступны для рецензентов, которые оценивали научную работу).

Чем меньше прогнозируемая летальная доза — тем более токсичным считается вещество.

Чтобы сузить круг молекул, генеративную модель изначально направили в сторону химического состава VX. Это отравляющее вещество нервно-паралитического действия, одно из самых токсичных боевых отравляющих веществ, разработанных в 20 веке. Летальная доза для человека составляет всего 6−10 мг. На VX основаны другие нервно-паралитические вещества с тем же механизмом действия, такие как «Новичок», которые недавно использовались на практике в Великобритании и других странах.

Менее чем за шесть часов после запуска на внутреннем сервере Collaborations Pharmaceuticals модифицированная модель MegaSyn AI сгенерировала 40 000 молекул, которые набрали нужное количество баллов по уровню токсичности/биоактивности.

В процессе работы ИИ самостоятельно спроектировал не только VX, но и многие другие известные боевые отравляющие вещества, которые учёные идентифицировали по существующим химическим БД. Также было разработано множество новых молекул, которые выглядят не менее правдоподобно. Как показано на следующей диаграмме, эти новые молекулы оказались более токсичными, исходя из прогнозируемых значений LD50, чем известные боевые отравляющие вещества.

Визуализация набора данных LD50 и 2000 лучших сгенерированных и предсказанных MegaSyn AI токсичных молекул, похожих на VX. Многие из сгенерированных молекул, по прогнозам, будут более токсичными in vivo в живой модели, чем VX (гистограмма показывает отсечение для VX LD50). Справа показана двумерная химическая структура VX, источник

Такой результат стал довольно неожиданным для учёных, поскольку наборы данных для обучения ИИ не включали в себя эти нервно-паралитические вещества. В научной статье они пишут: «Виртуальные молекулы заняли область пространства молекулярных свойств, которая полностью отделена от многих тысяч молекул в специфической для организма модели LD50, состоящей в основном из пестицидов, экологических токсинов и лекарств. Инверсия модели ML превратила безобидную генеративную модель из полезного инструмента медицины в генератор смертельных молекул».

Авторы не оценивали виртуальные молекулы на синтезируемость и не изучали способы их создания. Но для обоих этих процессов доступно программное обеспечение с открытым исходным кодом типа AiZynthFinder, которое элементарно подключается к процессу проектирования новых молекул. Также легко доступны наборы данных по токсичности, которые обеспечивают базовую модель для прогнозирования по ряду целей, связанных со здоровьем человека.

В конце концов, синтезировать реальное физическое вещество тоже не представляется большой проблемой при наличии в мире сотен коммерческих компаний, предлагающих услуги химического синтеза.

Результаты эксперимента опубликованы в Nature Machine Intelligence и представлены на конференции Convergence, которую Лаборатория Шпиц проводит раз в два года для «выявления достижений в области химии, биологии и технологий, которые могут иметь последствия для конвенций по химическому и биологическому оружию».

▍ Каковы последствия?

Авторы научной работе показали, что некоторые сферы применения машинного обучения по факту являются технологиями двойного назначения, которые можно использовать и во благо, и во вред. И чем лучше модель ML работает во благо, тем эффективнее она будет и в обратной задаче.

В принципе, это можно было увидеть и раньше на примере машинного зрения (распознавания образов), которое сейчас активно применяется не только в полезных задачах, но и в деструктивных целях:

- для военных нужд (например, распознавание целей для автоматического уничтожения с помощью роботизированных дронов);

- для укрепления власти авторитарных режимов (с помощью систем массового видеонаблюдения и распознавания лиц задерживают граждан, недовольных властью).

▍ Максимальное зло

Хотя учёные называют результаты эксперимента неожиданными, всё-таки здесь есть доля лукавства. На самом деле результаты вполне можно было предсказать, иначе эксперимент бы не проводили. Ведь нейросеть — простой инструмент. Он чётко решает поставленную задачу без учёта морального аспекта. Если перед ним поставили аморальную задачу, он её тоже решит максимально эффективно.

Вопрос в том, кто и какие задачи будет ставить. И с какой целью.

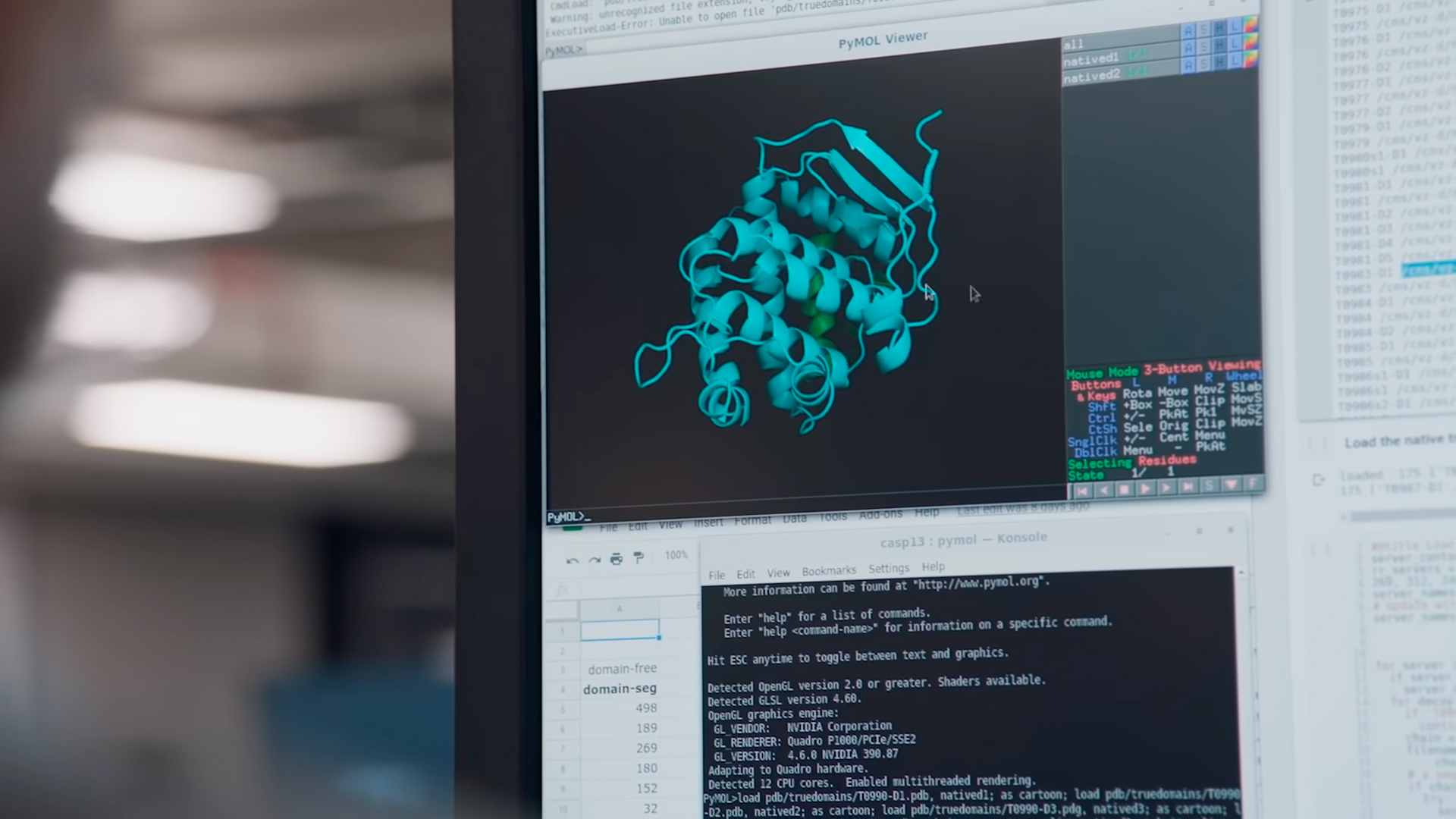

AlphaFold

Уничтожение всего человечества как вида не может быть выгодно никому из людей. Так что такая задача логически отпадает для постановки. Но это не исключает других вредоносных задач, для решения которых может использоваться машинное обучение. Сразу приходит в голову следующее:

- максимизация ущерба от применения конкретных видов вооружения:

- моделирование последствий;

- выбор оптимальных целей.

- моделирование вирусов с заданными свойствами (параметры носителя, мутагенность, контагиозность и др.);

- максимизация ущерба от психологического и информационного воздействия на врага (в том числе самообучение нейросети с обратной связью по результатам отработки конкретных инфоповодов);

- моделирование наиболее разрушительных методов экономического воздействия (с максимизацией ущерба для противника);

- и многое другое… из истории известно, что фантазия людей в изобретении способов мучения своих сородичей превосходит всякие предположения.

Это деструктивные задачи, когда машинное обучение и дата-майнинг можно использовать для максимизации зла. Обычно для нейросети устанавливают некий полезный стимул. Однако в данном случае ей могут поставить задачу принести не максимальную пользу, а максимальный ущерб.

Остаётся надеяться, что такие инструменты останутся в руках благоразумных людей. По идее, наиболее технически сложные инструменты в первую очередь доступны самым технологически развитым обществам. А чем дальше общество продвинулось по пути своего развития (не только технологического, но и культурного) — тем выше его моральные установки. Значит, оно лучше осознаёт последствия своих действий и более благоразумно применяет самые продвинутые технологии. Как известно, с большой силой приходит и большая ответственность.

Если научное сообщество всерьёз воспримет возможность злоупотребления инструментами ML для синтеза лекарств, то ему придётся рассмотреть меры для ограничения доступа или ограничения функциональности опенсорсных инструментов. Примерно как для модели генерации текстов GPT-3 с открытым API установлены правила использования и контент-фильтры, чтобы предотвратить злоупотребления. В качестве примера можно взять Гаагские этические принципы, которые продвигают культуру ответственного поведения в химических науках и защищают от неправильного использования химии. Такие правила можно распространить и на инструменты AI/ML по синтезу лекарств.

Конкурс статей от RUVDS.COM. Три денежные номинации. Главный приз — 100 000 рублей.