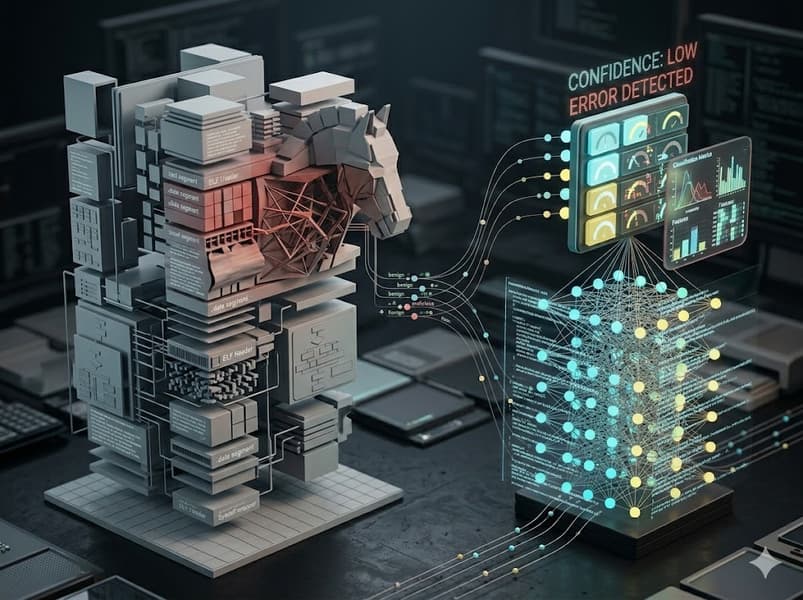

Команда специалистов из Чешского технического университета в Праге представила продвинутый генератор состязательных (adversarial) примеров, способный успешно обходить системы обнаружения угроз на базе машинного обучения. Инструментарий нацелен на манипуляцию файлами формата Linux ELF, что высвечивает критические уязвимости в современных ИИ-решениях для кибербезопасности.

Согласно отчету, предложенная методика позволяет в 67,74% случаев беспрепятственно обходить детекторы вредоносного ПО, при этом функциональность скомпрометированных файлов остается неизменной.

Если состязательные атаки на среду Windows PE изучены довольно подробно, то область бинарных файлов Linux до сих пор оставалась в тени, несмотря на колоссальную роль данных систем в облачных архитектурах, сегменте интернета вещей (IoT) и вычислительных кластерах.

В основе генератора лежит генетический алгоритм, оперирующий 12 различными техниками модификации и семью типами исходных данных. Такая вариативность позволяет создавать широкий спектр мутировавших файлов, нацеленных на дезориентацию алгоритмов классификации.

Исследователи тестировали систему на нейросети MalConv — популярном инструменте для анализа вредоносного кода. Суть метода заключается в сохранении исходной семантики файла: структура изменяется таким образом, чтобы не нарушить исполнение программы, но при этом радикально изменить вердикт модели.

Особую эффективность показало внедрение в тело вредоносного объекта фрагментов кода или строк, характерных для легитимного ПО. Эксперименты доказали: MalConv крайне восприимчива к таким вставкам независимо от того, в какой части файла они расположены. Это значительно упрощает задачу злоумышленника, так как ему не требуется глубокое понимание внутренней архитектуры целевого файла.

Помимо традиционного показателя вероятности обхода (evasion rate), эксперты ввели метрики EER (Extended Evasion Rate) и коэффициент деградации уверенности модели. Испытания показали, что новый генератор снижает уверенность MalConv в вердикте на 0,50, склоняя нейросеть к ошибочным решениям.

Работа подтверждает эскалацию «гонки вооружений» в киберпространстве. Предыдущие аналоги, такие как ADVeRL-ELF, демонстрировали успешность на уровне 59,5% в архитектурах ARM. Новый метод поднимает планку, подтверждая, что облачные сервисы и контейнерные среды Linux становятся крайне уязвимым звеном.

Авторы исследования настаивают: полагаться только на ML-детекторы опасно. Для обеспечения должного уровня защиты необходимо сочетать методы поведенческого анализа с тренировкой моделей на состязательных примерах, что позволит нейросетям распознавать подобные манипуляции.

Источник: iXBT