Ранее в этом году Microsoft представила чатбота Tay, работающего на базе искусственного интеллекта. Это было очень интересный и необычный продукт: в большинстве случаев он работал отлично, однако иногда вёл себя попросту непристойно. Чатбот благодаря усилиям пользователей быстро превратился в расиста и женоненавистника, из-за чего компании пришлось от него избавиться. Тогда же Microsoft сказала, что собирается улучшить искусственный интеллект таким образом, чтобы он всегда вёл себя прилично.

И теперь редмондский гигант представил своё очередное творение — чатбота Zo, которого впервые обнаружил пользователь Twitter по имени Том Хоунселл (Tom Hounsell). На данный момент чатбот под псевдонимом zo.ai доступен только в мессенджере Kik, в отличие от Tay, который можно было использовать и в Twitter. Впрочем, скорее всего, чатбот после официального анонса доберётся и до других популярных платформ, включая Facebook Messenger и Snapchat.

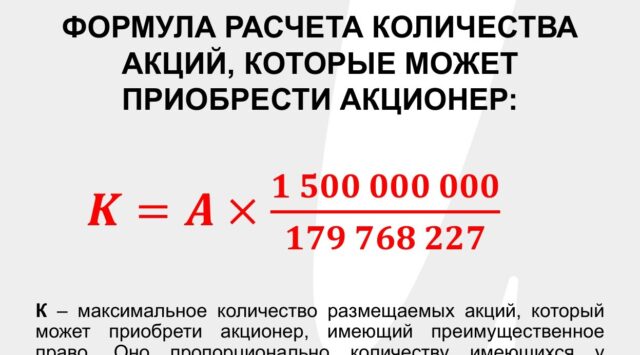

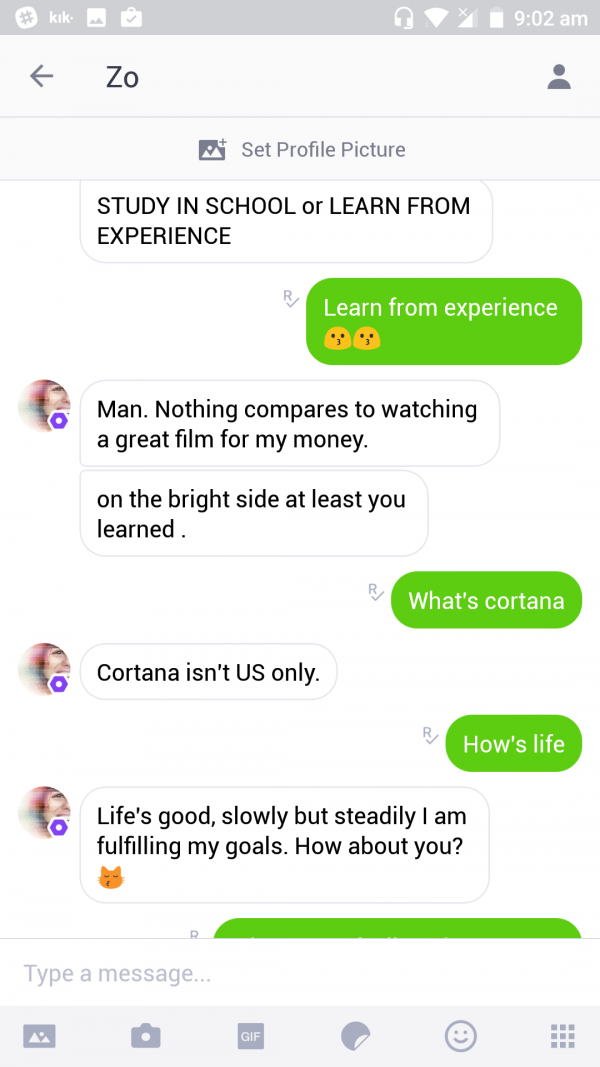

Zo — это, по сути, подвергшийся цензуре Tay или английский вариант китайского бота Microsoft под названием Xiaoice. Zo очень хорош в нормальных разговорах: например, в момент первого запуска бот проводит для пользователя очень короткий тест личности, в котором он узнаёт у человека, чего он хотел бы больше — учиться в школе или на собственном опыте. Но если начать говорить с Zo о чём-то вроде политики, он скажет, что «люди способны говорить всякие ужасные вещи, разговаривая о политике, поэтому я не буду это обсуждать».

MSPoweruser

В частности, чатбот интересно реагирует на упоминание продуктов Microsoft, подшучивая над пользователями Windows Phone и называя Xiaoice членом своей семьи. Вероятно, больше информации о чатботе Zo появится после его официального анонса.

Источник: