Голосовые ассистенты всё прочнее укрепляются в нашей жизни, что порой приводит к достаточно забавным и интересным ситуациям. Однако, как показал недавний случай, порой голосовой ассистент может быть опасным. Причём смертельно.

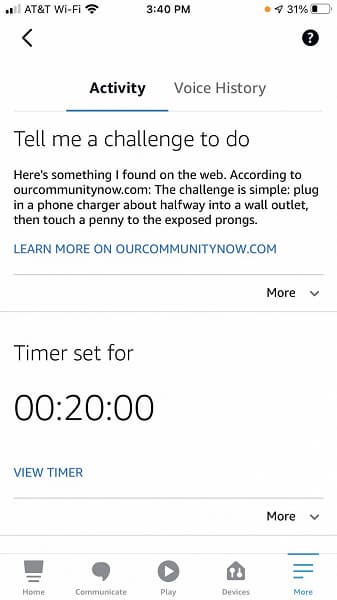

История произошла в США. 10-летняя девочка попросила голосовой помощник Alexa придумать ей челлендж. На что Alexa выдала следующее:

Вставьте зарядное устройство для телефона розетку примерно наполовину, а затем дотроньтесь до открытых контактов монеткой

Неизвестно, чем бы закончилась данная история, если бы рядом в этот момент не находилась мать девочки. Именно она и рассказала эту историю. В тот день мать с дочерью делали различные физические упражнения, и после выполнения очередного девочка попросила Alexa придумать для неё какой-то челлендж. Видимо, девочка по умолчанию подумала, что ИИ предложит выполнить ей какое-либо новое упражнение. Но получилось совсем иначе.

Расследование показало, что голосовой ассистент взял челлендж из некоего сообщества Our Community Now, изначально оговорив, что предлагаемый вызов ИИ нашёл в Сети. В целом же данный челлендж стал популярен в социальных сетях, включая TikTok, ещё около года назад. К примеру, один из таких случаев в прошлом году закончился пожаром. Ирония в том, что Alexa взяла текст вызова из статьи, которая как раз предупреждала родителей об опасности подобных челленджей.

Amazon сразу отреагировала на историю, заявив, что исправила ошибку, как только узнала о ней, правда, неясно, что именно в данном случае является ошибкой и как её исправили. В конце концов Alexa просто не способна понять опасность того или иного челленджа, который она наугад берёт в Сети.

Источник: iXBT

_large.png)