Пока мы готовим для вас обстоятельную техническую статью, поговорим и бизнесе и о трендах в сфере умных систем.

Очень быстрыми темпами в нашу жизнь входит работа с большими данными и «умными системами». И, как и у любого тренда, здесь сразу очень явно выявляется «узкое место». Это «узкое место» – интерфейс. Какой бы «умной» ни была система, с какими бы данными и насколько бы качественно она ни работала, результат ее работы должен быть понятен человеку. Сама работа с такой системой должна быть удобна пользователю. Наравне с внедрением цифровой трансформации, Big Data, IoT систем бизнес будет в явном виде требовать создания эргономичного и максимально интуитивного интерфейса взаимодействия человека с этими системами. Проблема качественных интерфейсных решений будет проявляться все более и более остро. И особенно остро эта проблема встает там, где с системой имеет дело не «специально обученный профессионал», а обычный пользователь.

Далее мы задались вопросом — что же такое «качественное интерфейсное решение»? Ответ на этот вопрос мы начали искать в кейсах. И логика подсказала нам посмотреть на кейсы с международной конференции CES2018, вот они:

www.youtube.com/watch?v=YUQ-UO42FGQ&t=528s – да, это тот самый ролик про разговор с LG Cloi (но ролик интересен далеко не только этим)

А вот еще несколько примеров:

www.youtube.com/watch?v=eSvku7qDqwQ — Virtual assistants once again dominate CES 2018

www.youtube.com/watch?v=RNCfzURD31U&t=81s — Honda Brings Robotic Devices to CES 2018

Кейсов очень много, прежде всего они указывают на огромное разнообразие интерфейсных решений, упорядочить которые очень сложно. Иногда в таких решениях бывает непросто найти и бизнес-составляющую – какие конкретно бизнес-задачи (задачи клиента) они должны решать и в каком функционале это должно выражаться.

Давайте посмотрим на несколько пунктов в отчете известного аналитического Gartner «Top Trends in the Gartner Hype Cycle for Emerging Technologies, 2018». На самом пике технологических ожиданий (Expectations) мы видим виртуальных ассистентов (Virtual Assistants) и умных роботов (Smart Robots). Стоит также обратить внимание и на этот отчет «Gartner Market Guide for Conversational Platforms, 20 June 2018».

Очень хорошим шагом к систематизации происходящего на рынке для нас выступил документ от PwC: «The Relevance and Emotional Lace” PwC Digital Services, Holobotics Practice».

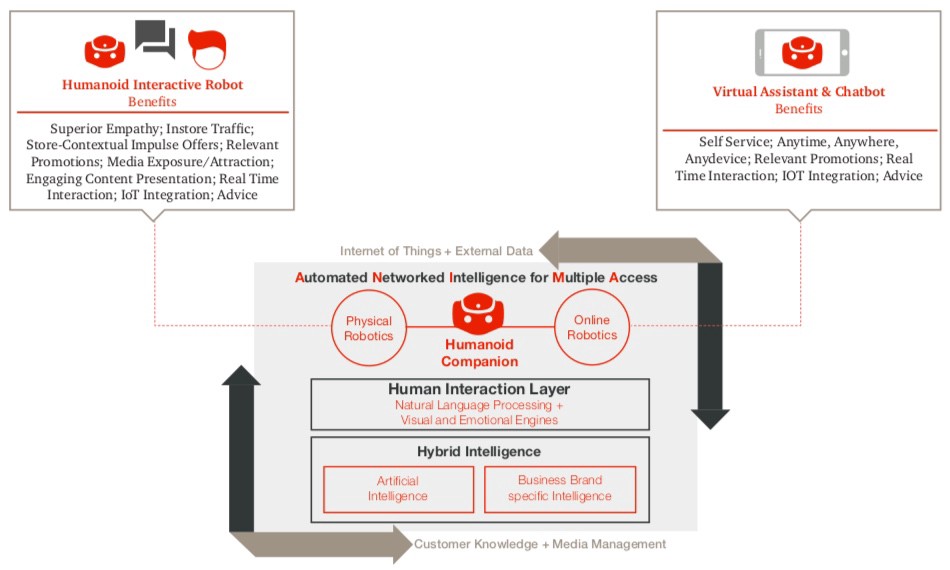

Документ объединяет чатботов (Chatbots), виртуальных ассистентов (Virtual Assistants) и интерактивных роботов (Humanoid Interactive Robots) в один тип интерфейсного решения – Humanoid Companion. Разделяя это решение на 2 подтипа – Physical Robotics и Online Robotics. Заметим, что сейчас указанные подсегменты рынка, решающие, по сути, похожую задачу создания качественного и эргономичного интерфейсного решения, сильно разделены – ими часто занимаются разные специализированные производители и поставщики, разные аналитики и т.д. Разбиение на подтипы в документе PwC основано на критерии «какое железо положено в основу решения» — физической робот, колонка, компьютер.

Automated Network Intelligence for Multiple Access. Credit: PWC. Available at: www.pwc.com/it/it/services/consulting/holobotics/docs/holobotics.pdf

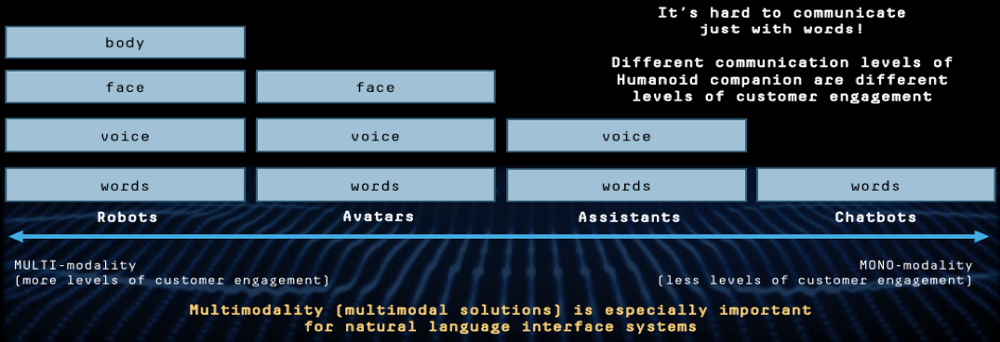

Мы предлагаем ввести другой критерий, который, на наш взгляд, позволит получить более ясную картину и более четкую систематизацию такого типа решений. Этот критерий – модальность взаимодействия, модальность, которая включена в интерфейсное решение. Рассмотрим детальнее.

Существуют 4 основных уровня/модальности, на которых происходит взаимодействие (удобное и эргономичное для человека): слова, голос, лицо, тело. Общаясь друг с другом, мы включаем в общение часть этих модальностей или все модальности сразу. Именно это мы сейчас и видим в интерфейсных системах – различные решения, направленные на одну и ту же задачу, но различающиеся в зависимости от того, какие модальности в них включены.

Credit: Neurodata Lab.

Приведем примеры (компании для примеров взяты из обзора Forrester «The Top 10 Chatbots For Enterprise Customer Service» www.forrester.com/report/The+Top+10+Chatbots+For+Enterprise+Customer+Service/-/E-RES138513):

Chatbot — в такого рода решениях используется только одна модальность – слова, текстовое взаимодействие.

• www.youtube.com/watch?v=Q8skLVLpKg4 – решения от компании Next IT

• www.youtube.com/watch?v=ngFNefOVt58 – чатботы от компании Nanorep

• www.youtube.com/watch?v=bR85Ob1Yipo — чатбот для построения чатботов от компании Reply.ai

Assistant – виртуальный ассистент предполагает наличие второй модальности – голоса, взаимодействия с помощью речи

• иногда это просто говорящий чатбот (IPsoft) — www.youtube.com/watch?v=rPURXuavMSk

• но в первую очередь сюда относятся решения, позволяющие вести полноценный диалог (Nuance) — www.youtube.com/watch?v=zJnqvo2kzxk

Avatar – это более сложные и более редкие решения, сейчас их можно увидеть в основном в HR-сфере

• vimeo.com/232671912 — Andi the Interview Coach — Multi-Modal Skype Bot, интересное решение от Botanic Technologies

• www.youtube.com/watch?v=w9PFVIHZ_AY – HR-решение от Российского стартапа (Робот-рекрутер Вера), вот так он выглядит в работе: www.youtube.com/watch?v=W5gl-meCKmE

Есть также некоторые, скажем так, промежуточные решения, которые используют разные модальности в зависимости от стороны взаимодействия (например, человек пишет, ассистент говорит и двигается, и так далее). Интересные примеры:

• www.youtube.com/watch?v=k31W34IMmB8 – Amelia от IPsoft

• www.youtube.com/watch?v=X5CaXaCS6L0 – Lisa от Artificial Solutions

Robot – и наши любимые Human Robots – мультимодальные коммуникативные агенты, работающие сразу на уровне 4 модальностей – слова, голос, лицо и тело.

• www.youtube.com/watch?v=Nm5KQrn9gxs&t=6s – Pepper от SoftBank Robotics

• www.youtube.com/watch?v=6Zt5u22BQCQ – Promobot от Promobot

• www.youtube.com/watch?v=qAEfKRSBtpw – Sanbot от QIHAN Robotics

• www.youtube.com/watch?v=20Qh9hYavIo – Cruzr от UBTECH Robotics

Vector by Anki. Credit: Anki.

Что особенно важно – включение новых модальностей с одной стороны открывает перед системой совершенно новые возможности, а с другой стороны требует дополнительных технологий — новых, передовых технологий в сфере ИИ, в частности, в сфере эмоционального искусственного интеллекта, направленных на работу с Natural Language Processing (обработки живого языка) и сфокусированных на (интерфейсных) решениях именно такого типа.

Если вы хотите получать наши новые публикации напрямую, если статья заинтересовала вас, и вы хотели бы получить доступ к демо-стенду, показывающему работу наших Emotion AI продуктов, вы можете связаться с автором статьи:

Olga Serdiukova

Chief Marketing Officer and Partner Development Director

Neurodata Lab LLC

Email: o.serdiukova@neurodatalab.com

LinkedIn: www.linkedin.com/in/olgaserdiukova

www.neurodatalab.com

Источник